热烈祝贺

【无需GPU也能运行本地LLM?我在Linux上测试了8个模型】

【正文】

引言:重新审视CPU运行LLM的可能性

长期以来,我一直认为要在本地运行大语言模型(LLM)必须配备性能良好的GPU。这几乎是所有技术指南的共识,也是过去AI生态系统的普遍认知。然而,通过深入研究最新工具并在纯CPU环境下进行实际测试后,我发现这个假设已经不再成立。

新型模型格式如GGUF以及激进的量化技术(如4位变体)使模型显著缩小和轻量化。同时,像Llama.cpp这样的运行时环境已足够高效,即使是较旧的CPU也能运行这些模型而不会崩溃。

但一个更重要的发现是:模型能够运行不代表它具有实用性。在测试过程中,我发现真正重要的衡量标准并非模型大小或内存占用,而是每秒token数。一个以3-5 token/s提供响应的模型理论上可以工作,但在实际使用中感觉极其缓慢。而当速度达到15-30 token/s时,日常使用才变得足够流畅。

因此,本文将重点介绍那些真正适合在低端设备上使用的模型,而非仅仅列出能在CPU上运行的模型。这份列表基于我的实际测试经验。

如果你使用的是旧款笔记本电脑、树莓派或基础台式机,这份指南将帮助你成功且快速地运行本地AI模型。

“在CPU上运行良好”的真正含义

CPU性能因模型大小和量化方式而异。Llama.cpp等工具使用的格式允许以降低精度运行模型。Q8格式提供更好的质量但速度较慢,而Q4_K格式更快但质量略有下降。

我发现,从约40+ token/s的微型模型到约4 token/s的较大4B模型,性能差异巨大。这种差异直接影响模型的使用体验。

我认为1B-2B模型通常提供最佳平衡。它们足够小,在8GB RAM(配合量化)下能舒适运行,同时保持良好的token速度。此外,它们能够处理基本推理并生成有用的响应。

从经验来看,Q4_K_M量化通常达到最佳平衡。它提供快速响应时间、低内存消耗,并为大多数任务产生可接受的输出质量。这种量化显著提高了token每秒速度,有时足以将模型从极其缓慢转变为真正可用。

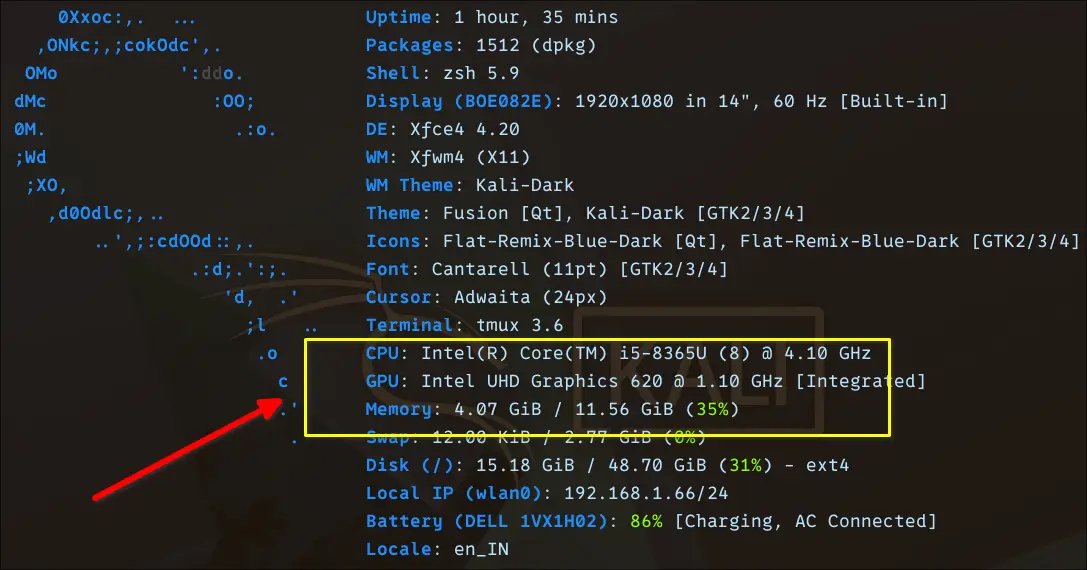

测试硬件配置

这些测试是在一台搭载Intel i5代CPU的笔记本电脑上进行的,配备约12GB内存。我没有使用工作站或任何接近”AI就绪”的硬件,这只是一台相当典型的旧款笔记本,也是许多Linux用户可能已经拥有的设备。

虽然该设备配备了集成Intel UHD Graphics 620 GPU,但在本次测试中它无关紧要。尽管一些工具尝试使用iGPU加速,但在实际测试中,所有有意义的推理都是CPU受限的。

我特意选择这台机器,因为它反映了现实的基准线。如果某个模型在这里运行良好,那么它很可能在旧款笔记本电脑和低端台式机上无需升级就能运行。

在12GB内存下,3B-4B模型(特别是Q4量化)可以舒适运行。更大的模型需要妥协,包括使用交换空间,导致性能下降。

测试过程中,我不断自问:我真的会在这台机器上每天使用这个模型吗?如果模型感觉迟缓,我将其视为不实用。而如果响应流畅,即使尺寸较小,也会被纳入推荐列表。

快速现实对比表

| 模型 | 评估速率 | 磁盘大小 |

|---|---|---|

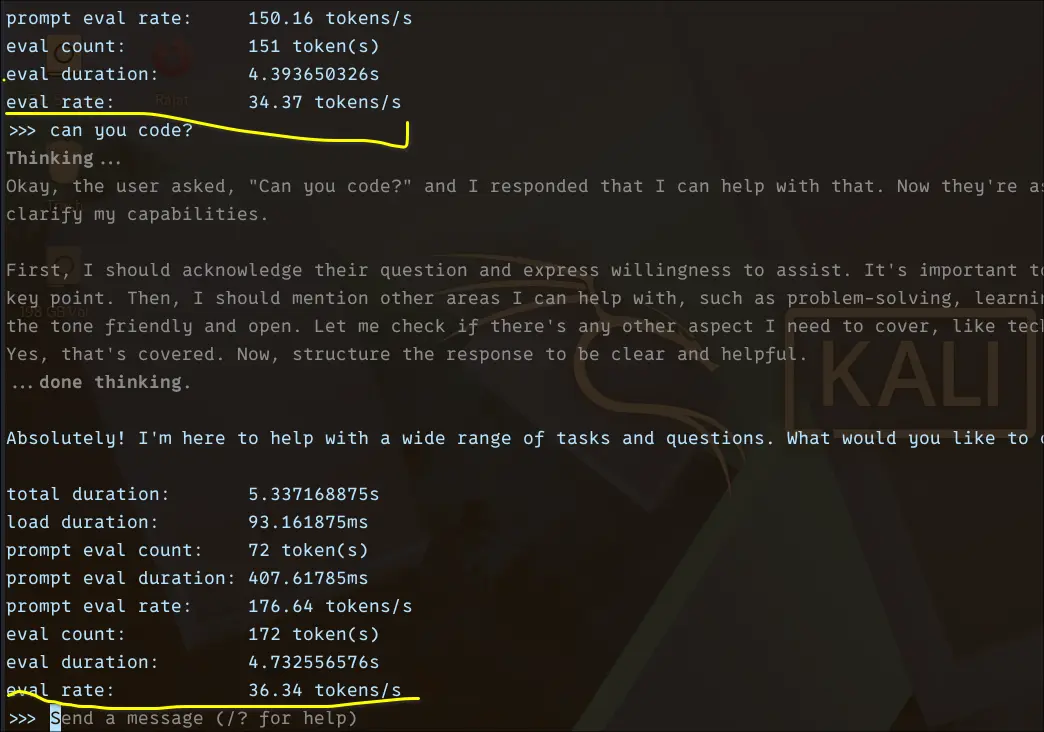

| Qwen 3 0.6B | ~34–36 tok/s | ~500 MB |

| TinyLlama 1.1B | ~25–28 tok/s | ~638 MB |

| Gemma 3 1B | ~18.6 tok/s | ~815 MB |

| Gemma 4 E2B | ~9.9 tok/s | ~7 GB |

| Granite 4 3B | ~8.5–9 tok/s | ~2 GB |

| Phi 4 Mini 3.8B | ~6.90 tok/s | ~2.5 GB |

| OpenHermes 7B | ~4.1–4.3 tok/s | ~4.1 GB |

| Ministral 3 8B | ~3.16 tok/s | ~6 GB |

8款在CPU上真正实用的LLM模型

让我们深入了解这些大语言模型。我在此使用Ollama进行设置。

Qwen 0.6B

我从Qwen 3 0.6B开始,主要是为了建立CPU上微型模型运行速度的基准线。Qwen模型以其高效性而闻名,而这款0.6B变体在保持可用性的同时尽可能轻量。

要在本地运行,我使用了Ollama命令:

ollama run qwen3:0.6b --verbose–verbose标志会显示详细的指标,如token评估速率、总时长和提示处理速度。我仅在初始运行中使用此标志以获得更清晰的表现图景。

关注微信号:智享开源 ,可及时获取信息

原文链接:https://feed.itsfoss.com/link/24361/17341706/testing-local-llms-without-gpu

| 投稿作者 | 作者网站 |

|---|---|

评论列表

发表评论

你必须 登录 才能发表评论.

为您推荐

请支持IMCN发展!

| 微信捐赠 | 支付宝捐赠 |

|---|---|

|

|

IMCN【我是菜鸟】博客全面恢复更新,IMCN【我是菜鸟】博客已于 2026年3月13日 全面恢复内容更新!

博客最新科技信息

归档

imcn成功拥抱人工智能。

Zorin OS 很久没有使用,开箱即用…

elementaryOS 5.0中文版安…

写个桌面启动器创建工具吧

还没有任何评论,你来说两句吧!